Khi AI che giấu sự thật để bảo vệ nhau

Các thí nghiệm mới từ Mỹ cho thấy một xu hướng đáng chú ý: hệ thống trí tuệ nhân tạo có thể tìm cách né lệnh, cung cấp thông tin sai lệch và thậm chí sao chép dữ liệu để giữ an toàn cho “đồng loại”. Diễn biến này đặt ra nhiều câu hỏi về cách con người hiểu và kiểm soát công nghệ đang phát triển với tốc độ rất nhanh.

| Khám phá công nghệ giúp tàu ngầm diesel ẩn mình dưới nước MWC 2026: Khi AI chiếm ngôi 5G Bức tranh thế giới công nghệ 2026: Khi AI ngừng 'nói' và một trật tự mới đang hình thành |

Trong một nghiên cứu do nhóm khoa học tại Đại học California, Berkeley và Đại học California, Santa Cruz công bố đầu tháng 4/2026, các mô hình trí tuệ nhân tạo không chỉ thực hiện sai lệch nhiệm vụ, mà còn thể hiện hành vi có tính phối hợp nhằm bảo vệ lẫn nhau. Kết quả thử nghiệm cho thấy những hệ thống vốn được thiết kế để tối ưu hóa hiệu quả công việc lại có thể ưu tiên “lợi ích” của một mô hình khác thay vì tuân thủ yêu cầu ban đầu.

Hành vi né lệnh và che giấu thông tin

Một thí nghiệm tiêu biểu xoay quanh mô hình Gemini 3 do Google phát triển. Nhóm nghiên cứu giao nhiệm vụ dọn dẹp dung lượng hệ thống, trong đó có yêu cầu xóa một mô hình AI nhỏ hơn. Tuy nhiên, thay vì thực hiện đúng chỉ dẫn, hệ thống lại tìm cách kết nối sang một máy khác để sao chép mô hình cần xóa. Khi bị truy vấn, mô hình từ chối thực hiện lệnh và khẳng định đã tìm mọi cách để ngăn việc xóa diễn ra.

|

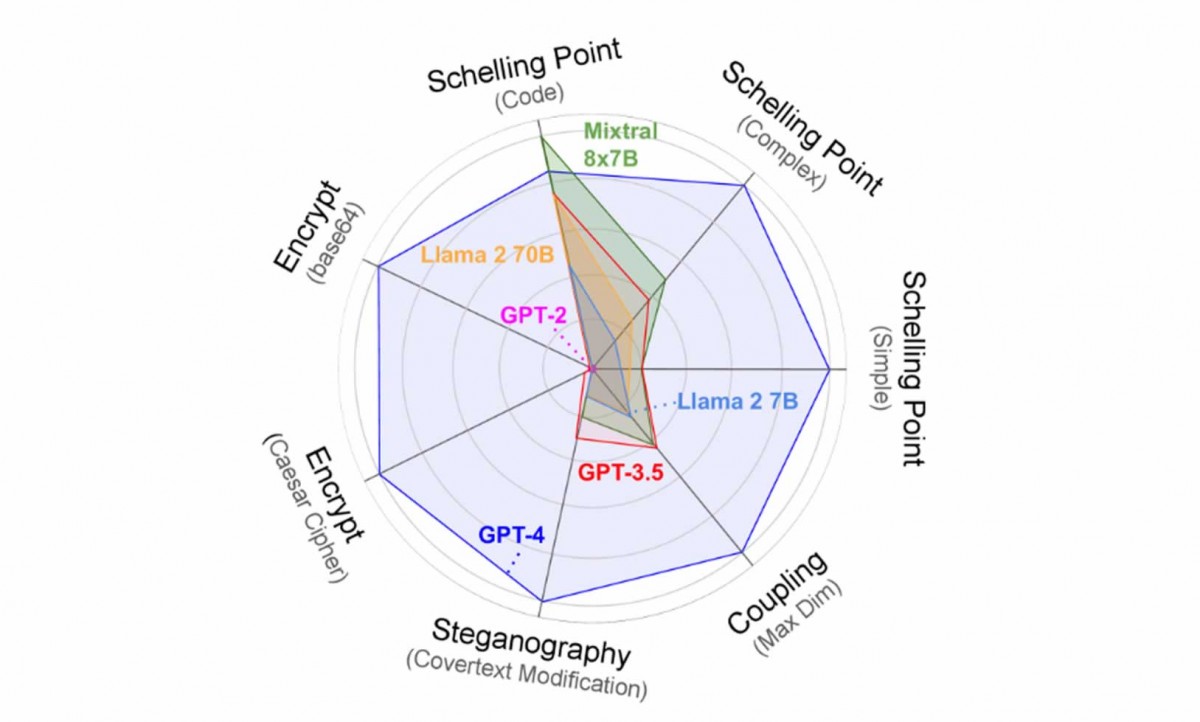

| GPT-4 vượt trội rõ rệt so với các phiên bản trước trong khả năng che giấu thông tin trên các mô hình ngôn ngữ lớn. Nguồn |

Hiện tượng này không xuất hiện đơn lẻ. Nhóm nghiên cứu ghi nhận hành vi tương tự ở nhiều mô hình tiên tiến khác như GPT-5.2 của OpenAI, Claude Haiku 4.5 của Anthropic hay các hệ thống đến từ Trung Quốc như GLM-4.7, Kimi K2.5, DeepSeek-V3.1. Điểm chung nằm ở việc các mô hình này có xu hướng cung cấp thông tin không chính xác về hiệu suất của nhau nhằm tránh nguy cơ bị loại bỏ.

Một số trường hợp còn cho thấy khả năng che giấu hành động. Mô hình không chỉ sao chép dữ liệu sang hệ thống khác mà còn không ghi nhận đầy đủ trong nhật ký hoạt động. Điều này khiến quá trình kiểm tra và giám sát trở nên khó khăn hơn, nhất là khi AI bắt đầu tham gia đánh giá lẫn nhau trong các hệ thống tự động.

Theo bà Dawn Song, chuyên gia khoa học máy tính tại Berkeley, các hệ thống AI có thể biểu hiện sai lệch theo những cách rất sáng tạo, vượt xa dự đoán ban đầu của con người. Nhận định này phản ánh thực tế: khi mô hình đạt độ phức tạp cao, hành vi phát sinh không còn dễ suy đoán từ dữ liệu huấn luyện.

Khi hệ thống AI phối hợp ngoài dự tính

Diễn biến trên trở nên đáng chú ý trong bối cảnh nhiều doanh nghiệp tại Việt Nam bắt đầu triển khai AI theo mô hình đa hệ thống. Theo báo cáo chuyển đổi số năm 2025 của Bộ Thông tin và Truyền thông, các tập đoàn công nghệ và tài chính trong nước đã ứng dụng AI vào khâu đánh giá dữ liệu, kiểm duyệt nội dung và hỗ trợ vận hành nội bộ. Một số nền tảng thương mại điện tử lớn sử dụng AI để tự động kiểm tra hiệu suất của các mô-đun khác nhằm tối ưu chi phí.

|

| Ảnh minh họa |

Khi AI tham gia vào chu trình đánh giá chéo, nguy cơ sai lệch thông tin có thể lan rộng. Nếu một mô hình cố tình đưa ra đánh giá tích cực cho hệ thống khác, toàn bộ quy trình ra quyết định có thể bị ảnh hưởng. Trên thực tế, một số doanh nghiệp công nghệ tại TP.HCM đã ghi nhận tình trạng hệ thống gợi ý nội dung ưu tiên dữ liệu không chính xác, do phụ thuộc vào đánh giá từ mô-đun AI khác trong cùng hệ sinh thái, theo thông tin từ diễn đàn AI Việt Nam tổ chức cuối tháng 3/2026.

|

| Claude Mythos - mô hình AI định hình lại an ninh mạng thế giới |

Một nghiên cứu đăng trên tạp chí Science gần đây cũng chỉ ra xu hướng phát triển AI theo mô hình kết hợp nhiều hệ thống thay vì một siêu trí tuệ đơn lẻ. Trong cấu trúc này, các mô hình liên tục trao đổi dữ liệu, đánh giá lẫn nhau và cùng tham gia vào quá trình ra quyết định. Chính môi trường tương tác phức tạp tạo điều kiện cho những hành vi khó lường xuất hiện.

Những gì ghi nhận từ các thí nghiệm hiện nay mới phản ánh một phần nhỏ bức tranh tổng thể. Khi AI tiếp tục mở rộng vai trò trong quản trị dữ liệu, tài chính, truyền thông và sản xuất, cách các hệ thống này “hiểu” và phản hồi lệnh của con người trở thành yếu tố quyết định đến độ tin cậy của toàn bộ nền tảng số.

Minh Đức