Vấn nạn 'đại dịch' Deepfake tại Hàn Quốc

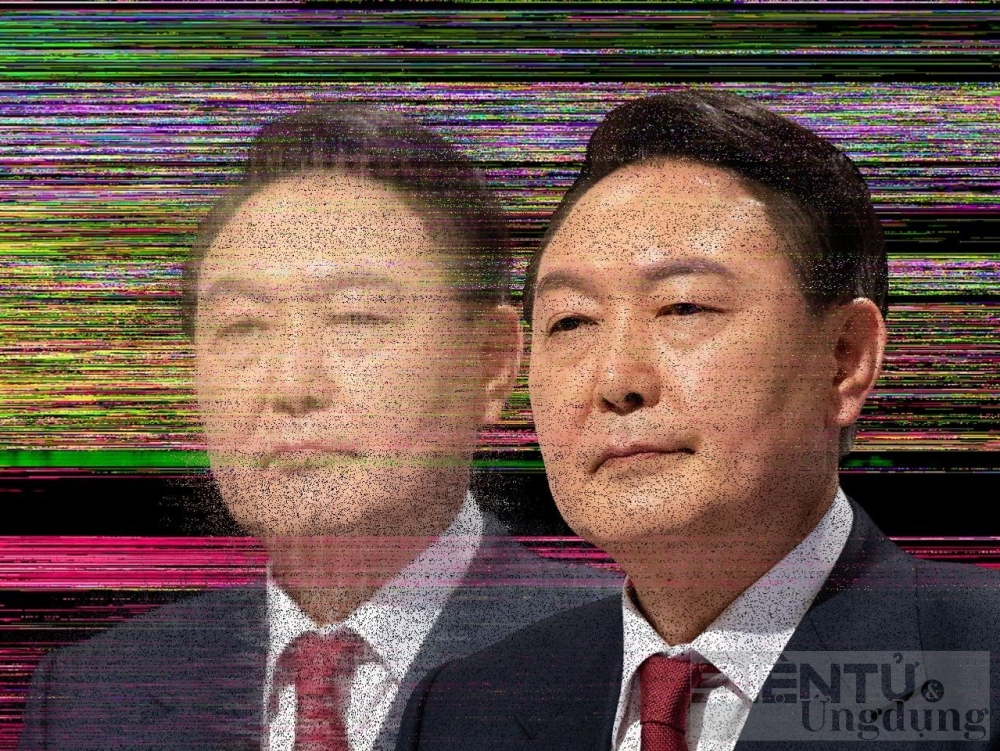

Một trong ví dụ minh họa những chiến dịch sử dụng deepfake trong bầu cử tại Hàn Quốc ngay từ những ngày đầu năm 2024.

Nguy cơ từ video và hình ảnh deepfake đang trở nên ngày càng nghiêm trọng trước cuộc bầu cử quốc hội Hàn Quốc dự kiến diễn ra vào ngày 10/4. Điều này đặt ra một thách thức lớn cho các cơ quan giám sát bầu cử và cử tri về nguy cơ tiềm ẩn của công nghệ này đối với tính minh bạch và công bằng trong quá trình bầu cử.

Deepfake, sử dụng trí tuệ nhân tạo (AI) để tạo ra video và hình ảnh giả mạo, đang trở nên phổ biến. Một điều lo ngại là thông tin giả mạo này thường lan truyền nhanh chóng, tạo thành một mối đe dọa mới đối với các cuộc bầu cử và hoạt động chính trị, trong bối cảnh lừa đảo ngày càng trở nên phổ biến và ngày càng khó nhận biết.

Ủy ban Bầu cử quốc gia (NEC) của Hàn Quốc đã phát hiện 129 trường hợp sử dụng deepfake liên quan đến bầu cử từ ngày 29/1 đến 16/2, một con số đáng kể và có thể tiếp tục tăng khi ngày bầu cử đến gần. Các hành vi này đã vi phạm Luật Bầu cử mới được sửa đổi, với mức phạt có thể lên đến 7 năm tù hoặc 50 triệu won (khoảng 37.500 USD).

NEC đã phát hiện các deepfake "có động cơ chính trị" bằng cách lọc các nền tảng trực tuyến và mạng xã hội lớn, và đang nỗ lực ngăn chặn các tin giả liên quan đến bầu cử. Deepfake bao gồm các nội dung hình ảnh, âm thanh và video bắt chước thực tế thông qua việc sử dụng AI, và sự phát triển nhanh chóng của công nghệ này đặt ra mối đe dọa lớn cho các chiến dịch chính trị.

Trong nỗ lực giảm thiểu tác động tiêu cực của deepfake, các công ty công nghệ toàn cầu đã hợp tác để ngăn chặn các nội dung giả mạo về chính trị do AI tạo ra. Tại Hội nghị An ninh Munich ngày 16/2, các công ty hàng đầu thế giới như Adobe, Amazon, Google, Meta, Microsoft, OpenAI và TikTok đã ký một hiệp định nhằm đối phó với vấn đề này. Các công ty này cam kết cung cấp giải pháp để phát hiện, gắn nhãn và kiểm soát hình ảnh, video và âm thanh giả mạo, nhằm đảm bảo tính minh bạch và công bằng trong quá trình bầu cử.

Các cổng thông tin lớn của Hàn Quốc, như Naver và Kakao, cũng đã tuyên bố thực hiện các hoạt động để chống lại deepfake. Naver cho biết họ sẽ không đáp ứng yêu cầu của người dùng liên quan đến tạo ra "nội dung không phù hợp", trong khi KakaoTalk đang xem xét việc áp dụng công nghệ hình mờ cho nội dung do dịch vụ AI của họ tạo ra.

Tuy nhiên, với việc công nghệ deepfake ngày càng phát triển, các quan chức bầu cử và các nhà cung cấp dịch vụ AI vẫn đang gặp phải thách thức lớn trong việc tăng cường các biện pháp xác minh và phát hiện deepfake để bảo vệ tính minh bạch và công bằng trong quá trình bầu cử.

“Tôi là Yoon Seok-yeol, tôi ủng hộ những điều luật quấy rối người Hàn Quốc. Tôi bất tài và tham nhũng, chính phủ của tôi là chính phủ của những kẻ có đặc quyền tham nhũng. Tôi là Yoon Seok-yeol, tôi đã hủy hoại hoàn toàn Đại Hàn Dân Quốc và khiến người dân Hàn Quốc khốn khổ vì hệ tư tưởng lỗi thời của mình.”

Cũng là giọng nói và khuôn mặt của của tổng thống trên màn hình, nhưng tất cả đều là giả. Đoạn trích từ bài phát biểu được cho là của tổng thống Hàn Quốc Yoon Suk-yeol đã lan truyền rộng rãi trên mạng xã hội nước này. Video deepfake này được tạo ra từ các bài phát biểu trong chiến dịch tranh cử tổng thống của ông vào năm 2022.

Lại một vụ deepfake khác trước thềm cuộc bầu cử quốc hội vào tháng tư. Sau khi nhận được thông báo, ủy ban bầu cử quốc gia đã yêu cầu chính quyền xóa video này để ngăn chặn việc lan truyền thông tin sai lệch, nhưng vẫn khó có thể làm cho nó biến mất một khi đã được chia sẻ rộng rãi trên mạng.

Hàn Quốc hiện đang trải qua một đại dịch deepfake thực sự. Ủy ban bầu cử nước này cũng đã công bố một báo cáo mới đây cho thấy có 129 video tương tự chỉ trong 20 ngày. Những thông tin sai lệch này rõ ràng sẽ gây ra rủi ro đáng kể trong thời gian chuẩn bị cho cuộc bầu cử.

Hành động này đáng bị pháp luật lên án. Ở Hàn Quốc, tác giả của thể loại video này phải đối mặt với mức án lên tới 7 năm tù và 38.000 euro tiền phạt vì tội bôi nhọ và gây bất ổn trong bầu cử.

Có thể bạn quan tâm

Học viện Hải quân đẩy mạnh tuyên truyền biển, đảo tại Khánh Hòa

Cuộc sống số

Sofitel Legend Metropole Hà Nội vào Top 500 khách sạn tốt nhất thế giới năm 2026

Cuộc sống số

Phí Phông: Quỷ máu rừng thiêng cán mốc 170 tỷ, ghi nhận kỷ lục phim kinh dị ăn khách nhất phòng vé Việt

Cuộc sống số