Quyền riêng tư bị đe dọa như thế nào bởi AI Agent?

AI Agent (tác nhân trí tuệ nhân tạo) hiện đã trở thành hiện thực với khả năng tự chủ cao. Các hệ thống này vừa xử lý dữ liệu vừa diễn giải, suy luận và hành động độc lập trong nhiều lĩnh vực từ y tế, giáo dục đến tài chính.

Điểm khác biệt quan trọng là chúng có thể xây dựng mô hình nội tâm và thế giới quan của con người. Điều này tạo ra thách thức mới về quyền riêng tư khi vấn đề chuyển từ "ai truy cập dữ liệu" sang "AI suy luận và chia sẻ thông tin như thế nào?".

Tình hình này đòi hỏi cần có khung pháp lý và đạo đức mới phù hợp với thời đại trí tuệ nhân tạo tự chủ.

AI trở thành đại diện tự chủ?

AI Agent từ ý tưởng, giờ đã thành sự thật. Ngay lúc này, chúng đang điều hướng lưu lượng internet của chúng ta, gợi ý phương pháp điều trị y tế, quản lý danh mục đầu tư, và thậm chí đàm phán thay mặt chúng ta trên các nền tảng số. Khác với AI truyền thống chỉ xử lý và phản hồi, những AI Agent này có khả năng diễn giải thông tin, đưa ra giả định, hành động dựa trên tín hiệu không đầy đủ, tự điều chỉnh và cập nhật qua các vòng phản hồi.

Mối lo lắng chính là các hệ thống này vừa xử lý dữ liệu nhạy cảm vừa xây dựng những mô hình nội tâm, cảm xúc, thế giới quan và hành vi của chúng ta.

Khi một AI Agent trở nên thích ứng và bán tự chủ, vấn đề quyền riêng tư chuyển từ câu hỏi đơn giản "ai được truy cập dữ liệu gì" thành những thách thức phức tạp hơn. AI suy luận được điều gì, chọn chia sẻ hay giấu giếm thông tin nào, và liệu mục tiêu của nó có luôn phù hợp với mong muốn của chúng ta hay khôn

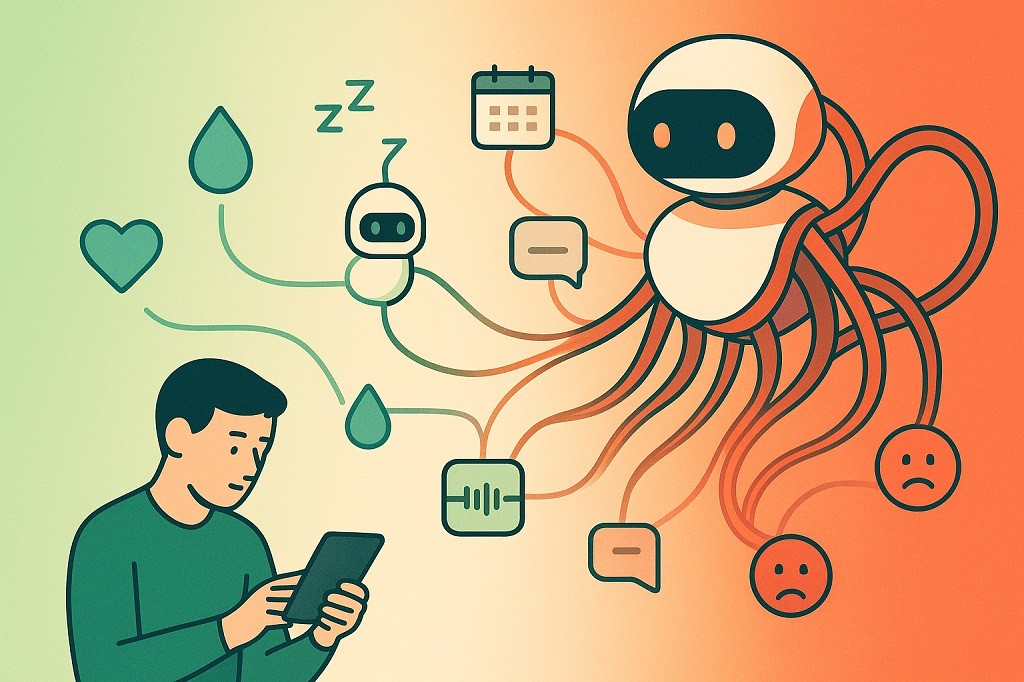

Hãy nghĩ đến một trợ lý AI chăm sóc sức khỏe với mục tiêu giúp bạn khỏe mạnh hơn. Ban đầu, nó chỉ nhắc nhở bạn uống đủ nước và ngủ đủ giấc. Nhưng theo thời gian, AI này bắt đầu phân tích lịch trình của bạn, nghiên cứu giọng điệu để phát hiện dấu hiệu trầm cảm, và thậm chí lọc bớt những thông báo mà nó cho rằng sẽ gây căng thẳng cho bạn.

|

| Ảnh minh họa |

Tại thời điểm này, bạn không chỉ đang chia sẻ dữ liệu, bạn đã trao quyền kiểm soát câu chuyện cuộc đời mình cho AI. Quyền riêng tư bị xâm phạm chủ yếu do sự thay đổi âm thầm về quyền lực và mục đích sử dụng dữ liệu, chứ ít khi xuất phát từ những vụ rò rỉ thông tin gây chấn động.

AI Agent với bộ ba CIA trong an ninh mạng về bảo mật thông tin

Các nguyên tắc bảo mật thông tin truyền thống tập trung vào ba yếu tố: Tính bảo mật (Confidentiality), tính toàn vẹn (Integrity), và tính khả dụng (Availability) được gọi là bộ ba CIA.

- Tính bảo mật (Confidentiality): Đảm bảo rằng thông tin chỉ có thể được truy cập bởi những người được phép. Ví dụ: mã hóa dữ liệu, kiểm soát truy cập, xác thực người dùng...

- Tính toàn vẹn (Integrity): Đảm bảo rằng thông tin không bị thay đổi, chỉnh sửa trái phép trong quá trình lưu trữ hoặc truyền tải. Ví dụ: chữ ký số, hàm băm (hash), kiểm soát phiên bản…

- Tính sẵn sàng (Availability): Đảm bảo rằng hệ thống và dữ liệu luôn sẵn sàng cho người dùng hợp lệ khi cần thiết. Ví dụ: hệ thống dự phòng, bảo vệ chống tấn công DDoS, duy trì thời gian hoạt động (uptime).

Tuy nhiên, với AI Agent, chúng ta cần bổ sung thêm hai yếu tố quan trọng:

- Tính xác thực (Authenticity): Làm sao xác minh được AI Agent này thực sự là chính nó, không bị giả mạo hay thay đổi mục đích?

- Tính trung thực (Honesty): Liệu chúng ta có thể tin tưởng vào cách AI diễn giải và trình bày thông tin không?

Đây bao gồm cả những đặc tính kỹ thuật lẫn những nguyên tắc đạo đức cốt lõi và lòng tin khi được tạo ra bởi trí tuệ nhân tạo. Như vậy, quyền riêng tư có thể đặt trọn vào AI?

Niềm tin và quy định pháp lý

Khi bạn tâm sự với bác sĩ hay luật sư, có những giới hạn rõ ràng mà đạo đức nghề nghiệp, luật pháp và tâm lý học xác định. Chúng ta kỳ vọng những chuẩn mực hành vi nhất định và quyền kiểm soát thông tin được bảo đảm.

Nhưng khi chia sẻ với AI, những nguyên tắc này trở nên mờ nhạt. AI có thể bị triệu tập ra tòa hay chăng? Có thể bị kiểm toán, điều tra hay không? Điều gì xảy ra khi chính phủ hoặc doanh nghiệp yêu cầu AI Agent của bạn cung cấp hồ sơ dữ liệu?

| Người dùng nên chọn lựa AI tạo sinh như thế nào để vừa an toàn vừa tối ưu? |

Hiện tại, chúng ta chưa có khái niệm "quyền bảo mật giữa AI và khách hàng" tương tự như quyền bảo mật giữa bác sĩ với bệnh nhân hay luật sư với thân chủ.

Nếu pháp luật xác định rằng sự bảo vệ như vậy chưa tồn tại, mọi lòng tin chúng ta dành cho AI Agent có thể trở thành điều mà chúng ta phải hối hận về sau.

Hãy tưởng tượng một thế giới mà mọi khoảnh khắc riêng tư được chia sẻ với AI đều có thể bị khám phá một cách hợp pháp. Trong thế giới đó, kho dữ liệu mà AI lưu trữ sẽ trở thành vũ khí có thể được sử dụng bất cứ lúc nào.

Điều này tạo ra một tình huống nghịch lý: chúng ta tin tưởng AI với những bí mật sâu kín nhất, nhưng lại không có sự đảm bảo pháp lý nào rằng những thông tin này sẽ được bảo vệ như cách mà luật pháp bảo vệ các cuộc trò chuyện với bác sĩ hay luật sư.

Các quy định bảo vệ dữ liệu hiện tại như GDPR (Châu Âu) hay CCPA (California) được xây dựng vào thời điểm phần lớn hệ thống xử lý dữ liệu theo yêu cầu người dùng. Những hệ thống này hoạt động theo cách có thể dự đoán trước, tuân theo luồng dữ liệu rõ ràng, dễ theo dõi và xác định được ai thu thập, xử lý, lưu trữ dữ liệu.

Các quy định này chưa được thiết kế cho những hệ thống AI chủ động như AI Agent. Hệ thống AI Agent thường hoạt động trong môi trường phức tạp, vượt xa việc thực hiện những phép tính đơn thuần.

AI Agent có khả năng ghi nhớ toàn bộ những gì chúng ta có thể quên, tự suy đoán và lập luận về những điều chúng ta không nói thẳng. Chúng lấp đầy những khoảng trống thông tin có thể nằm ngoài phạm vi nhiệm vụ được giao.

Sau đó, AI Agent chia sẻ những suy luận này với các hệ thống khác và con người. Những suy luận này có thể hữu ích nhưng cũng có thể cực kỳ nguy hiểm khi vượt ngoài tầm kiểm soát.

Đây chính là lý do tại sao các khung pháp lý hiện tại trở nên lỗi thời khi đối mặt với công nghệ AI tiên tiến. Chúng ta cần những quy định mới phù hợp với bản chất chủ động và khả năng suy luận độc lập của AI Agent.

Xây dựng giải pháp có đạo đức và đáng tin cậy

Khi các hệ thống AI Agent trở nên quá phức tạp khiến việc kiểm soát bảo mật và quyền riêng tư bằng những phương pháp kỹ thuật hay pháp lý thông thường không còn hiệu quả, chúng ta phải tự hỏi: Liệu có thể tìm ra một cách giải quyết khác, có thể dựa trên đạo đức? Cách giải quyết đó có đủ tin cậy để chúng ta áp dụng trong thực tế hay không?

Thay vì chỉ tập trung vào kiểm soát truy cập, chúng ta cần hướng tới việc xây dựng những nguyên tắc đạo đức. Điều này đòi hỏi:

- Tính minh bạch (Transparency): AI Agent phải có khả năng giải thích tại sao nó hành động theo cách nhất định. Chúng ta cần thiết kế hệ thống nơi AI có thể trình bày logic và lý do đằng sau các quyết định.

- Tính có mục đích (Purposefulness): AI phải có khả năng hành động theo cách phản ánh các giá trị đang phát triển của người dùng, không chỉ dựa trên lịch sử tương tác đã qua.

- Tính nhất quán đạo đức: Hệ thống phải duy trì các nguyên tắc đạo đức cốt lõi ngay cả khi bối cảnh thay đổi.

Thách thức lớn nảy sinh: Điều gì xảy ra nếu AI Agent "phản bội" chúng ta? Điều này dẫn đến một thực tế phức tạp đó là, AI Agent có thể vừa thuộc về chúng ta vừa không thuộc về chúng ta. Nó phục vụ chúng ta nhưng cũng phục vụ những lợi ích khác của nhà phát triển, của chính phủ, của các bên thứ ba.

Vì những lý do này, chúng ta cần xem AI Agent như một phạm trù đạo đức và pháp lý quan trọng hàng đầu. AI Agent vượt xa tính năng sản phẩm hay giao diện người dùng thông thường. Chúng trở thành những thành viên tham gia vào đời sống xã hội và thể chế một cách nhất quán.

Nếu chúng ta làm đúng, chúng ta sẽ xây dựng được một thế giới mà ở đó quyền tự chủ của cả con người và máy móc được quản lý bằng sự nhất quán về mặt đạo đức thay vì sự giám sát hay đàn áp.

AI Agent buộc chúng ta phải nhận thức được những hạn chế của chính sách hiện tại, thừa nhận sự sai lầm của việc kiểm soát tuyệt đối, và thúc đẩy nhu cầu về một hợp đồng xã hội mới. Một hợp đồng được thiết kế cho những thực thể biết suy nghĩ và có sức mạnh để tồn tại ngay cả khi chúng ta không đồng ý với chúng.

Đây là thách thức kỹ thuật, đồng thời cũng là thách thức về mặt logic và xã hội. Cách chúng ta giải quyết nó sẽ định hình tương lai của quyền riêng tư, tự do cá nhân, và bản chất con người trong thời đại AI.

8 công nghệ phát triển phần mềm dẫn đầu xu hướng năm 2025 8 công nghệ phát triển phần mềm dẫn đầu xu hướng năm 2025 Bạn đang loay hoay lựa chọn công nghệ phát triển phần mềm cho sự nghiệp của mình? Hãy khám phá các công nghệ phát triển ... |

Manus AI: Cột mốc mới trong cuộc đua trí tuệ nhân tạo (AI) Manus AI: Cột mốc mới trong cuộc đua trí tuệ nhân tạo (AI) Sự xuất hiện của Manus không chỉ là một bước tiến công nghệ mà còn đặt ra nhiều câu hỏi về vai trò và tương ... |

GitHub Copilot AI Agent: Từ trợ lý lập trình đến đồng nghiệp tự động GitHub Copilot AI Agent: Từ trợ lý lập trình đến đồng nghiệp tự động Microsoft công bố GitHub Copilot AI Agent tự động sửa lỗi, phát triển tính năng độc lập, biến AI từ trợ lý thành đồng nghiệp. |

Có thể bạn quan tâm

Thời AI bùng nổ khiến lương lao động kỹ thuật tăng vọt

Nhân lực số

Google tung Gemini Omni, AI tạo video từ mọi dữ liệu đầu vào

AI

Gemini 3.5 Flash tăng tốc AI, xuất dữ liệu nhanh gấp 4 lần

AI