Google ra mắt TPU 8 hiệu năng gấp 3 lần, thách thức chip AI của Nvidia

Nvidia và sức nặng của 'vương miện AI' Nvidia và sức nặng của 'vương miện AI' Trong thế giới công nghệ nơi tốc độ đổi mới quyết định ngôi vương, chiếc “vương miện AI” mà Nvidia đang đội ngày càng trở ... |

Chip Trung Quốc bùng nổ doanh thu kỷ lục nhờ AI và lệnh cấm của Mỹ Chip Trung Quốc bùng nổ doanh thu kỷ lục nhờ AI và lệnh cấm của Mỹ Ngành công nghiệp bán dẫn Trung Quốc đang ghi nhận một nghịch lý đáng chú ý: chính các biện pháp hạn chế công nghệ từ ... |

CEO Qualcomm gặp Samsung, SK Hynix, LG để chốt chip AI thế hệ mới CEO Qualcomm gặp Samsung, SK Hynix, LG để chốt chip AI thế hệ mới CEO Qualcomm Cristiano Amon bay sang Seoul gặp trực tiếp lãnh đạo cấp cao Samsung Electronics, SK Hynix và LG Electronics trong hai ngày liên ... |

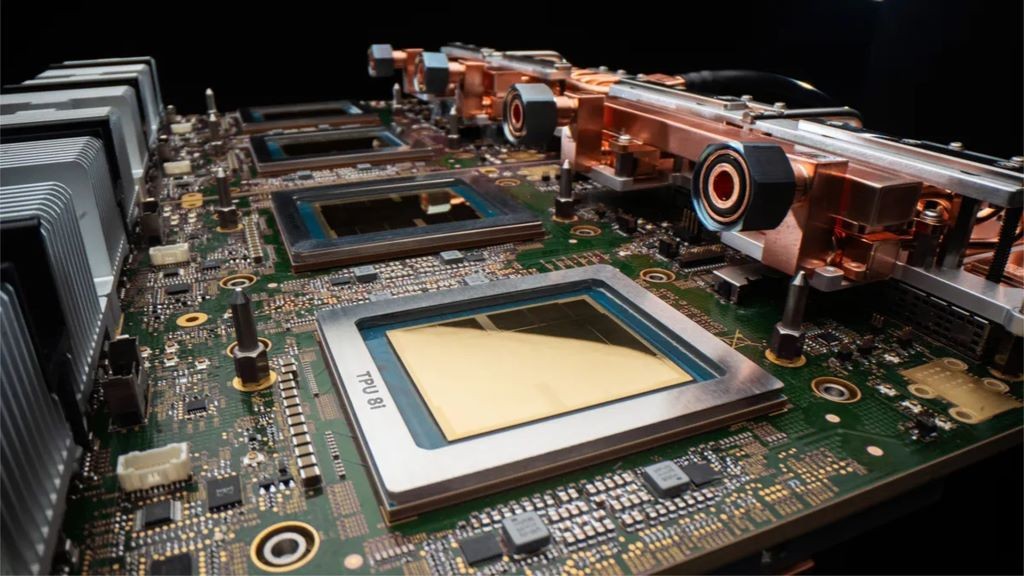

Google vừa công bố thế hệ chip TPU thứ tám tại sự kiện Google Cloud Next, lần đầu tiên trong lịch sử dòng sản phẩm này công ty tách hẳn hai con chip riêng biệt theo chức năng: TPU 8t chuyên huấn luyện mô hình AI quy mô lớn và TPU 8i chuyên xử lý suy luận. Cả hai sẽ được bán rộng rãi qua Google Cloud vào cuối năm nay.

Quyết định tách đôi TPU 8 không phải là lựa chọn kỹ thuật đơn thuần. Nó phản ánh một thay đổi căn bản trong cách các công ty lớn tiêu thụ điện toán AI: huấn luyện và suy luận là hai bài toán khác nhau về bản chất, đòi hỏi kiến trúc phần cứng khác nhau, và việc dùng một chip đa năng cho cả hai ngày càng trở nên lãng phí.

|

| Dòng chip TPU 8 được Gooogle công bố trong bối cảnh nhu cầu về điện toán AI nhanh hơn và hiệu quả hơn đang tăng cao. Ảnh: Google |

Tại sao Google tách đôi thay vì gộp chung

Huấn luyện một mô hình AI lớn là công việc xảy ra một lần hoặc vài lần, kéo dài hàng tuần đến hàng tháng, cần tối đa hóa tốc độ tính toán thuần túy trên số lượng chip khổng lồ. Suy luận là công việc xảy ra hàng tỷ lần mỗi ngày khi người dùng gửi câu hỏi đến ChatGPT, Gemini hay bất kỳ dịch vụ AI nào, ưu tiên là độ trễ thấp, chi phí mỗi lần xử lý phải cực kỳ thấp và hệ thống phải chạy liên tục không gián đoạn.

Một chip tối ưu cho cả hai mục tiêu đó thường không xuất sắc ở mục tiêu nào. Google nhận ra điều này và thiết kế TPU 8t với từng thông số hướng đến huấn luyện: một siêu cụm duy nhất có thể mở rộng lên tới 9.600 chip, đạt tổng hiệu năng 121 exaflops, con số gấp gần 3 lần so với thế hệ trước Ironwood. Quan trọng hơn, Google cho biết TPU 8t đặt mục tiêu "hiệu suất thực tế" trên 97%, tức là hơn 97% thời gian chip đang tính toán thực sự thay vì chờ dữ liệu hoặc xử lý sự cố.

Con số 97% đó nghe có vẻ kỹ thuật nhưng mang ý nghĩa thực tiễn rất lớn. Trên một cụm hàng nghìn chip chạy liên tục nhiều tuần, mỗi phần trăm thời gian nhàn rỗi tích lũy thành hàng ngày lịch trình bị kéo dài và hàng triệu đô la chi phí bị lãng phí. Việc nâng hiệu suất thực tế lên 97% là một trong những cải tiến có giá trị kinh tế cao nhất mà một nhà sản xuất chip huấn luyện có thể thực hiện, dù nó không xuất hiện trong bất kỳ con số marketing nào.

TPU 8i và bài toán chi phí của kỷ nguyên AI agent

|

| Microsoft đang tăng tốc phát triển chip riêng cho trung tâm dữ liệu AI |

TPU 8i giải quyết bài toán hoàn toàn khác. Con chip này mang 288 GB bộ nhớ băng thông cao và 384 MB SRAM tích hợp trực tiếp trên chip, cho phép giữ dữ liệu mô hình ở sát bộ xử lý để phản hồi nhanh hơn mà không phải chờ đọc từ bộ nhớ ngoài. Nó còn tích hợp CPU Axion của Google dựa trên kiến trúc Arm và được tối ưu cho kiến trúc Mixture of Experts, loại mô hình chỉ kích hoạt một phần tham số tại mỗi thời điểm thay vì toàn bộ, giúp cắt giảm chi phí tính toán mà không đánh đổi hiệu năng.

Tại sao hiệu năng trên mỗi đô la lại là thước đo quan trọng hơn hiệu năng thô trong giai đoạn hiện tại? Vì cuộc đua AI đã chuyển sang giai đoạn triển khai đại trà. Huấn luyện GPT-4 hay Gemini Ultra là công việc của vài trăm kỹ sư trong vài tháng. Nhưng phục vụ hàng trăm triệu người dùng mỗi ngày là công việc kéo dài vô thời hạn, chi phí cộng dồn theo từng giờ. Google cho biết TPU 8i mang lại hiệu năng trên mỗi đô la tốt hơn 80% so với Ironwood, tức là cùng ngân sách điện toán đám mây, khách hàng xử lý được gần gấp đôi khối lượng công việc.

Google cũng tiết lộ chiến lược hai chip này hình thành trực tiếp từ sự trỗi dậy của AI agent, các hệ thống AI tự động lập kế hoạch, thực thi nhiệm vụ nhiều bước và tương tác liên tục với công cụ khác. Không giống người dùng gõ câu hỏi rồi đọc câu trả lời, AI agent chạy liên tục trong nền, đòi hỏi hạ tầng suy luận vừa nhanh vừa rẻ vừa ổn định, đúng những gì TPU 8i được xây dựng để đáp ứng.

Tuyên chiến thực sự với Nvidia

|

| AMD thách thức Nvidia khi hé lộ siêu chip AI MI400 |

Tại sao TPU 8 là đòn tấn công trực tiếp nhất vào Nvidia so với mọi thế hệ TPU trước đó? Vì lần này Google không chỉ cải thiện chip mà còn xây dựng toàn bộ hệ sinh thái xung quanh để triệt tiêu lý do khách hàng phải chọn Nvidia.

TPU 8t và TPU 8i hỗ trợ đầy đủ các framework phổ biến gồm JAX, PyTorch, SGLang và vLLM – tức là các nhóm kỹ thuật không cần viết lại code hay học công cụ mới khi chuyển sang TPU. Đây là rào cản lớn nhất mà các thế hệ chip thay thế Nvidia từng vấp phải: hệ sinh thái CUDA của Nvidia quá sâu rễ trong cộng đồng AI, ai muốn thoát ra phải trả chi phí chuyển đổi cao. Google đang trực tiếp tháo gỡ rào cản đó.

Cả hai chip còn dùng hệ thống làm mát bằng chất lỏng thế hệ thứ tư và đạt hiệu năng trên mỗi watt gấp đôi Ironwood, thông số ngày càng quan trọng khi chi phí điện và làm mát tại trung tâm dữ liệu leo thang cùng quy mô AI toàn cầu.

| Nvidia giới thiệu Chip AI mạnh nhất thế giới, tăng tốc 30 lần so với phiên bản trước |

Nếu Google duy trì lộ trình này và giải quyết được câu hỏi về hệ sinh thái phần mềm, TPU 8 có thể tạo ra áp lực giá thực sự lên dịch vụ đám mây AI của Nvidia và các đối tác phân phối GPU H100, H200, điều mà các thế hệ TPU trước chưa làm được vì còn phụ thuộc nhiều vào nhu cầu nội bộ của Google.

Với các doanh nghiệp Việt Nam đang sử dụng Google Cloud để chạy mô hình AI, TPU 8i khả thi về chi phí hơn nhiều so với việc thuê GPU H100, loại chip đang có giá thuê cao và thường xuyên hết hàng trên các nền tảng đám mây toàn cầu. Mức cải thiện 80% hiệu năng trên mỗi đô la, nếu được xác nhận trong thực tế, có thể rút ngắn thời gian hoàn vốn cho các dự án AI đang triển khai theo mô hình pay-as-you-go.

Giá thuê cụ thể của TPU 8t và TPU 8i trên Google Cloud chưa được công bố tại thời điểm bài viết.

| Bốn khái niệm cần biết để hiểu về TPU 8 Exaflops là đơn vị đo tốc độ tính toán, tương đương một tỷ tỷ phép tính dấu phẩy động mỗi giây. 121 exaflops của siêu cụm TPU 8t là con số cho thấy quy mô tính toán mà trước đây chỉ các siêu máy tính quốc gia mới đạt được. Hiệu suất thực tế (utilization) đo tỷ lệ thời gian chip đang tính toán hữu ích thay vì chờ dữ liệu hoặc xử lý lỗi – 97% là mức rất cao, phản ánh chất lượng phần cứng lẫn phần mềm điều phối. Mixture of Experts là kiến trúc mô hình AI chỉ kích hoạt một phần tham số cho mỗi tác vụ thay vì toàn bộ, giảm chi phí tính toán mà không cắt giảm năng lực tổng thể của mô hình. AI agent là hệ thống AI tự lên kế hoạch và thực thi chuỗi nhiệm vụ nhiều bước, khác với chatbot chỉ trả lời từng câu hỏi đơn lẻ, agent cần hạ tầng suy luận chạy liên tục và phản hồi nhanh để xử lý hàng nghìn bước trong một luồng công việc. |

Có thể bạn quan tâm

AI mở rộng bề mặt tấn công: Ngân hàng đối mặt chiến tranh mạng thế hệ mới

Bảo mật

ChatGPT Images 2.0 nâng cấp hiển thị chữ, giữ đồng nhất nhân vật

AI

CEO Qualcomm gặp Samsung, SK Hynix, LG để chốt chip AI thế hệ mới

AI